- FR

- NL

- EN

L'IA en soutien, mais l'humain aux manettes: les Belges privilégient le jugement humain dans le recrutement

Temps de lecture: 5 min | 17 avr. 2026 à 04:00

Ce qui est permis et ce qui ne l'est pas !

L'intelligence artificielle s'immisce de plus en plus dans le processus de recrutement. Les employeurs y recourent pour screener des CV, préparer des entretiens et même évaluer des candidats. Mais dans le même temps, une enquête du prestataire de services RH Partena Professional, menée en collaboration avec Stijn Baert auprès de 1 000 travailleurs et 250 employeurs, révèle que les travailleurs font peu confiance à cette technologie.

« Le message est clair : l'IA peut aider, mais décider ? Non merci », conclut Olivier Poot General Manager HR Technology chez Partena Professional.

L'IA déjà profondément ancrée dans le processus de recrutement

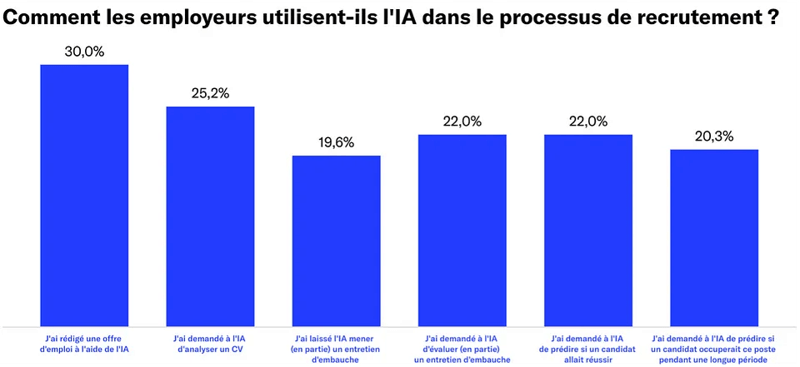

Une nouvelle enquête de Partena Professional, en collaboration avec Stijn Baert, auprès de 1 000 travailleurs et 250 employeurs, révèle qu'aujourd'hui un quart des employeurs utilise l'IA pour screener des CV. Trois sur dix rédigent des offres d'emploi à l'aide de l'intelligence artificielle, mais l'usage ne s'arrête pas au soutien rédactionnel.

Près d'un employeur sur cinq a déjà laissé l'IA conduire (partiellement) des entretiens d'embauche. Autant de professionnels des ressources humaines ont déjà fait évaluer les entretiens de candidats par l'IA, et plus d'un sur cinq a utilisé l'IA pour prédire si un candidat réussirait dans la fonction ou y resterait longtemps. L'IA n'est donc plus seulement un assistant, mais de plus en plus un évaluateur actif. C'est là que le bât blesse.

Les travailleurs sont critiques : « Ne laissez pas l'IA décider »

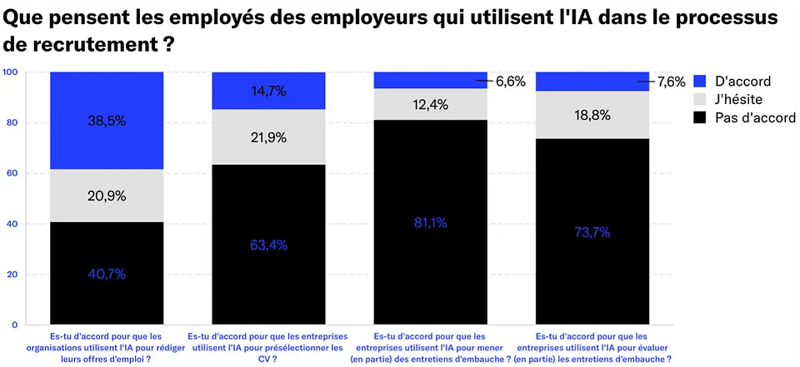

Plus de six travailleurs sur dix (63,4 %) estiment qu'il n'est pas acceptable que les employeurs fassent screener un CV par l'IA. Seuls 14,7 % y sont favorables, les autres ont des doutes. Lorsqu'il s'agit de faire évaluer les entretiens d'embauche, la proportion de ceux qui trouvent cela acceptable chute même à 7,6 %.

À noter : les femmes se montrent plus critiques envers l'IA dans la sélection que les hommes. Les francophones font également preuve de plus de réticence que les néerlandophones.

Des doutes sur l'équité et les biais

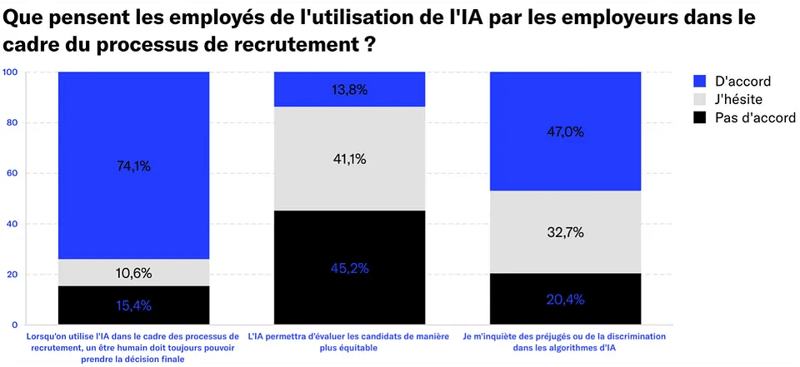

Ce qui frappe également, c'est l'importance que les travailleurs accordent au contrôle humain. 74,1 % estiment qu'un être humain doit toujours prendre la décision finale. Du côté des employeurs, cette proportion est d'ailleurs nettement inférieur : 54,6 %.

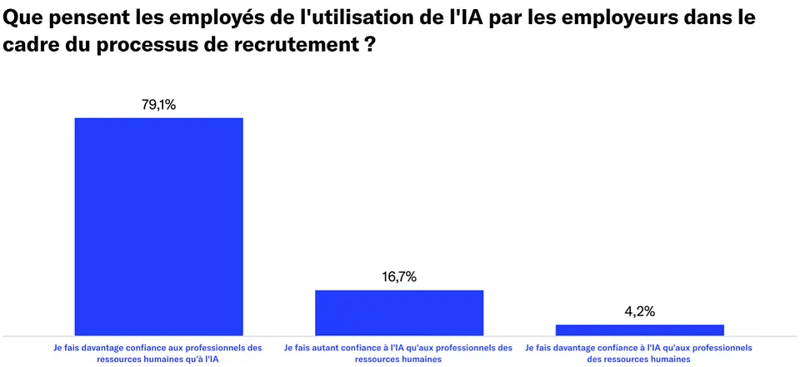

Par ailleurs, 79,1 % des travailleurs font davantage confiance aux collaborateurs RH qu'à l'IA. Seulement 4,2 % déclarent avoir plus confiance en l'intelligence artificielle qu'en un recruteur humain.

Selon Olivier Poot General Manager HR Technology chez Partena Professional, cela témoigne d'une limite claire dans l'acceptation sociale : « Les Belges voient l'IA comme un outil, pas comme un décideur. Dès lors qu'il est question de leur emploi et de leur revenu, les gens ne veulent pas d'un algorithme qui tranche sur leur avenir. L'IA peut apporter un soutien, mais la responsabilité doit rester humaine. »

L'idée que l'IA serait plus objective ne convainc pas davantage. Près de la moitié des travailleurs ne croit pas que l'IA évaluera les candidats de manière plus équitable. 47,0 % s'inquiètent même des préjugés ou de la discrimination dans les algorithmes d'IA, contre seulement 20,4 % qui ne s'en inquiètent pas (les autres sont indécis).

L'IA dans le recrutement : ce qui est permis et ce qui ne l'est pas

Partena Professional souligne que le recours à l'IA dans le recrutement et la sélection n'est pas interdit, mais qu'il est strictement encadré. Les employeurs doivent respecter la législation en matière de protection des données à caractère personnel (RGPD), la législation antidiscriminatoire et, dans un avenir proche, également le règlement européen sur l'intelligence artificielle (AI Act).

« L'IA peut accroître l'efficacité et contribuer à l'objectivation, mais elle n'est pas un bouclier juridique », souligne Poot. « La responsabilité finale incombe toujours à l'employeur. Qui fait appel à l'IA doit le faire de manière réfléchie et transparente. »

Points d'attention importants pour les employeurs :

- L'intervention humaine reste indispensable : les décisions automatisées sans contrôle humain sont interdites.

- La transparence à l'égard des candidats est obligatoire : les candidats doivent être informés lorsque l'IA est utilisée.

- Le contrôle des biais est nécessaire : les employeurs restent responsables des éventuelles discriminations, même lorsqu'un algorithme appuie la sélection.

- La minimisation des données et la proportionnalité sont cruciales : pas toutes les formes d'analyse de données ne sont autorisées.

- Valorisez le rôle du dialogue social au sein de votre entreprise et informez les travailleurs et les représentants des travailleurs.

________________________________________

À propos de l'enquête

Partena Professional a élaboré, avec le soutien du professeur d'économie du travail Stijn Baert, un questionnaire afin d'obtenir un aperçu des questions susmentionnées. Ce questionnaire a été soumis entre le 27 janvier 2026 et le 10 février 2026 à un échantillon représentatif de 1 000 travailleurs belges et 250 employeurs.

Des caractéristiques socio-démographiques ont également été recueillies auprès des répondants, telles que le sexe, la taille de l'entreprise et la langue maternelle (néerlandais ou français), afin de pouvoir ventiler les résultats selon ces caractéristiques. La marge d'erreur maximale est de 3,02 % pour 1 000 travailleurs belges et de 6,16 % pour 250 employeurs belges.